Nace la lectura de la mente, que se detiene si no piensas en la contraseña.

Primer sistema que decodifica pensamientos sólo con órdenes: 4 pacientes se comunican imaginando palabras gracias a la lectura mental protegida.

La lectura de la mente ya no es ciencia ficción, sino una realidad clínica que está transformando la vida de personas como casey harrell... La interfaz cerebro-computadora logró una precisión del 97% en la decodificación del lenguaje intentado, lo que le permitió comunicarse durante más de 248 horas

Gianluca Riccio

es.futuroprossimo.it 15 Agosto 2025

Casey se despierta cada mañana sabiendo que las palabras que quiere decir permanecen atrapadas en su mente. La esclerosis lateral amiotrófica le ha arrebatado la voz, pero no sus pensamientos. Ahora, por primera vez, un equipo de científicos ha logrado construir un puente entre su cerebro y el mundo exterior. La interfaz desarrollada en Stanford puede leer el habla interna de pacientes como Casey, transformando los pensamientos silenciosos en palabras audibles. La tecnología solo funciona cuando el paciente "piensa" una contraseña especial: una protección que impide la lectura no deseada de la mente.

Lectura de mentes con contraseña: cómo funciona

Investigación dirigida por Erin Kunz dell 'Universidad Stanford Demostró por primera vez que es posible decodificar el "habla interna" con un 74 % de precisión. El equipo trabajó con cuatro participantes con parálisis grave causada por esclerosis lateral amiotrófica o accidentes cerebrovasculares del tronco encefálico. Los microelectrodos implantados en la corteza motora pueden captar las débiles señales neuronales que se generan cuando una persona imagina hablar, sin mover un solo músculo. La verdadera innovación reside en el mecanismo de protección: el sistema comienza a decodificar los pensamientos sólo cuando el paciente piensa en la frase “Chitty Chitty Bang Bang”, reconocida con un 98,75% de precisión.

Los resultados, publicado en la revista Cell, muestran que el habla intentada y la interna activan regiones cerebrales superpuestas, generando patrones neuronales similares, pero con menor intensidad. Como explica Benyamin Meschede-Krasa, coautor del estudio:

“Si simplemente tienes que pensar en el discurso en lugar de intentar hablar, es potencialmente más fácil y rápido para la gente”.

El algoritmo de IA traduce estos patrones en palabras de un vocabulario de 125.000 palabras, logrando un rendimiento que supera a muchas aplicaciones de voz comerciales para teléfonos inteligentes.

Lo que hace que este sistema sea realmente especial es su capacidad para distinguir entre el habla interna voluntaria e involuntaria. Durante las pruebas, La interfaz incluso fue capaz de captar números que los participantes estaban contando mentalmente sin que se les pidiera que lo hicieran. Este descubrimiento llevó a los investigadores a desarrollar el mecanismo de contraseña para garantizar que sólo los pensamientos autorizados se traduzcan en comunicación.

De la parálisis a la comunicación fluida

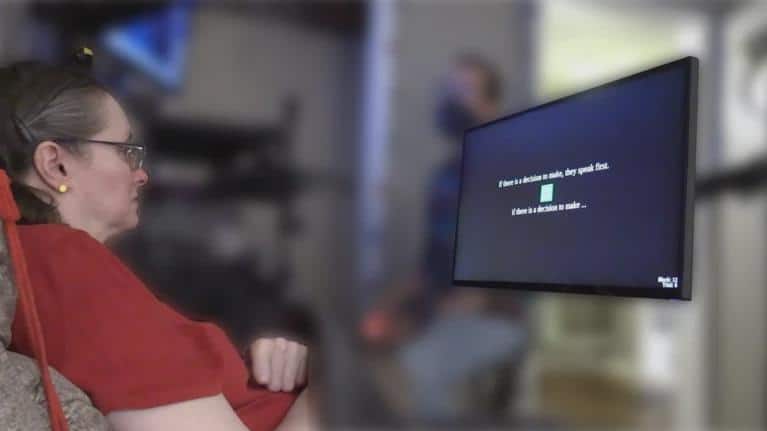

La lectura de la mente ya no es ciencia ficción, sino una realidad clínica que está transformando la vida de personas como casey harrell, el paciente de 45 años que participó en otro estudio paralelo realizado por elUniversidad de California DavisEn su caso, La interfaz cerebro-computadora logró una precisión del 97% en la decodificación del lenguaje intentado, lo que le permitió comunicarse durante más de 248 horas en conversaciones espontáneas con familiares y amigos. La primera vez que el sistema funcionó, Harrell lloró de alegría al ver sus palabras aparecer en la pantalla..

La tecnología se basa en grupos de microelectrodos más pequeños que una aspirina infantil, implantados quirúrgicamente en la capa superficial del cerebro. Estos dispositivos registran la actividad neuronal directamente de la corteza motora, la región que controla los movimientos voluntarios, incluidos los necesarios para el habla. Las señales se transmiten por cable a un algoritmo de aprendizaje automático que las traduce en acciones como producir texto o mover el cursor. Como señala: Frank Willett, codirector del Laboratorio Traslacional de Prótesis Neuronales de Stanford:

“Descodificar las señales neuronales registradas durante el habla interna fue un logro importante, pero antes de implementarse en la práctica clínica, será necesario confirmar su seguridad y eficacia en un mayor número de pacientes”.

El potencial terapéutico es enorme: según elOrganización Mundial de la SaludAproximadamente 1,3 millones de personas viven con discapacidades de moderadas a graves. Las interfaces cerebro-computadora podrían devolver la autonomía comunicativa a quienes sufren parálisis, accidentes cerebrovasculares, esclerosis lateral amiotrófica o lesiones de la médula espinal. El mercado de interfaz cerebro-computadora, valorado en 2 millones de dólares en 2023, podría triplicarse en 2030.

Un participante del estudio, con dificultad para hablar con claridad debido a un accidente cerebrovascular, utiliza la interfaz cerebro-computadora. Imagen: Equipo Emory BrainGate.

La privacidad de los pensamientos en la era digital

La capacidad de leer la mente plantea profundas cuestiones éticas que van mucho más allá del ámbito médico. Si un dispositivo puede decodificar lo que piensas, ¿qué sucede cuando esa tecnología cae en las manos equivocadas? Investigadores de Stanford anticiparon estas preocupaciones al desarrollar lo que denominan una "dimensión de control neuronal". El sistema puede distinguir entre el habla interna y el intento de habla, lo que permite a los usuarios elegir el modo de comunicación.

Como explica Kunz: “Queríamos investigar si existía el riesgo de que el sistema decodificara palabras que no estaban destinadas a ser pronunciadas en voz alta”. La respuesta llegó en forma de una contraseña mental. Cuando los participantes piensan en la frase clave, el sistema se activa y comienza a decodificar. Cuando dejan de pensar, la interfaz se desactiva automáticamente. Una solución elegante que permite al usuario controlar la situación.

Sin embargo, la tecnología aún está en sus primeras etapas. Los sistemas cerebro-computadora actuales son experimentales, costosos y solo están disponibles para unos pocos pacientes seleccionados en ensayos clínicos controlados. La miniaturización de los electrodos, la biocompatibilidad a largo plazo y la variabilidad individual de las señales cerebrales aún representan desafíos técnicos que deben superarse. Los dispositivos actuales funcionan durante más de 1000 días después de su implantación, pero requieren una calibración frecuente para mantener la precisión.

El futuro de la lectura mental asistida

Los desarrollos futuros buscan hacer esta tecnología más accesible y potente. Los investigadores están explorando regiones cerebrales distintas a la corteza motora, como áreas tradicionalmente asociadas con el lenguaje o la audición, que podrían contener información más detallada sobre el habla imaginada. El hardware inalámbrico y totalmente implantable eliminaría los cables externos, mientras que algoritmos más sofisticados podrían aumentar significativamente la precisión y el vocabulario disponible.

Empresas como Neuralink, sincronizador e Paradromicos están desarrollando interfaces neuronales de próxima generación, mientras que gigantes tecnológicos como Apple y Meta están invirtiendo en soluciones no invasivas basadas en sensores externos. Hemos visto esto con proyectos como MindPortal:El objetivo a largo plazo es crear sistemas que permitan la comunicación directa entre el cerebro y la inteligencia artificial.

El futuro de las interfaces cerebro-computadora es prometedor. Este trabajo ofrece una esperanza real de que las interfaces lingüísticas puedan algún día restaurar una comunicación tan fluida, natural y cómoda como el habla conversacional.

El camino hacia interfaces cerebro-computadora verdaderamente prácticas aún es largo, pero el progreso logrado en los últimos meses es alentador. Por primera vez, hemos demostrado que es posible leer los pensamientos manteniendo el control de la privacidad en manos del usuario. Una contraseña mental que protege nuestra privacidad cognitiva y abre nuevas posibilidades para quienes han perdido la voz.

Tal vez el futuro de la comunicación humana realmente esté en el pensamiento, pero siempre con nuestro consentimiento explícito.

__________

Gianluca Riccio, directora creativa de Melancia adv, redactora y periodista. Forma parte del Instituto Italiano para el Futuro, World Future Society y H+. Desde 2006 dirige Futuroprossimo.it, el recurso italiano de Futurología. Es socio de Forwardto - Estudios y habilidades para escenarios futuros. Síguelo en LinkedIn

________

Fuente: